Deepfake é uma tecnologia baseada em inteligência artificial que permite a criação de conteúdos falsificados, manipulando imagens, vídeos e áudios por meio de redes neurais generativas.

Por alterar a realidade de forma convincente, os deepfakes podem gerar impactos negativos significativos, como a propagação de fake news, a invasão de privacidade e crimes relacionados à reputação de terceiros.

Para se proteger contra deepfakes, é essencial fortalecer a segurança dos dados na internet, especialmente em redes sociais. Limitar a exposição de informações pessoais dificulta a ação de fraudadores.

A seguir, descubra o que é um deepfake, como ele funciona, os riscos envolvidos nessa tecnologia e as melhores formas de se prevenir contra manipulações digitais.

Qual o significado de deepfake?

O termo deepfake surge da combinação de “deep learning” (“aprendizado profundo”) e “fake” (“falsificação”). Ele descreve uma técnica baseada em inteligência artificial capaz de alterar e criar conteúdos manipulados, como imagens, vídeos e áudios falsos.

Como um deepfake é criado?

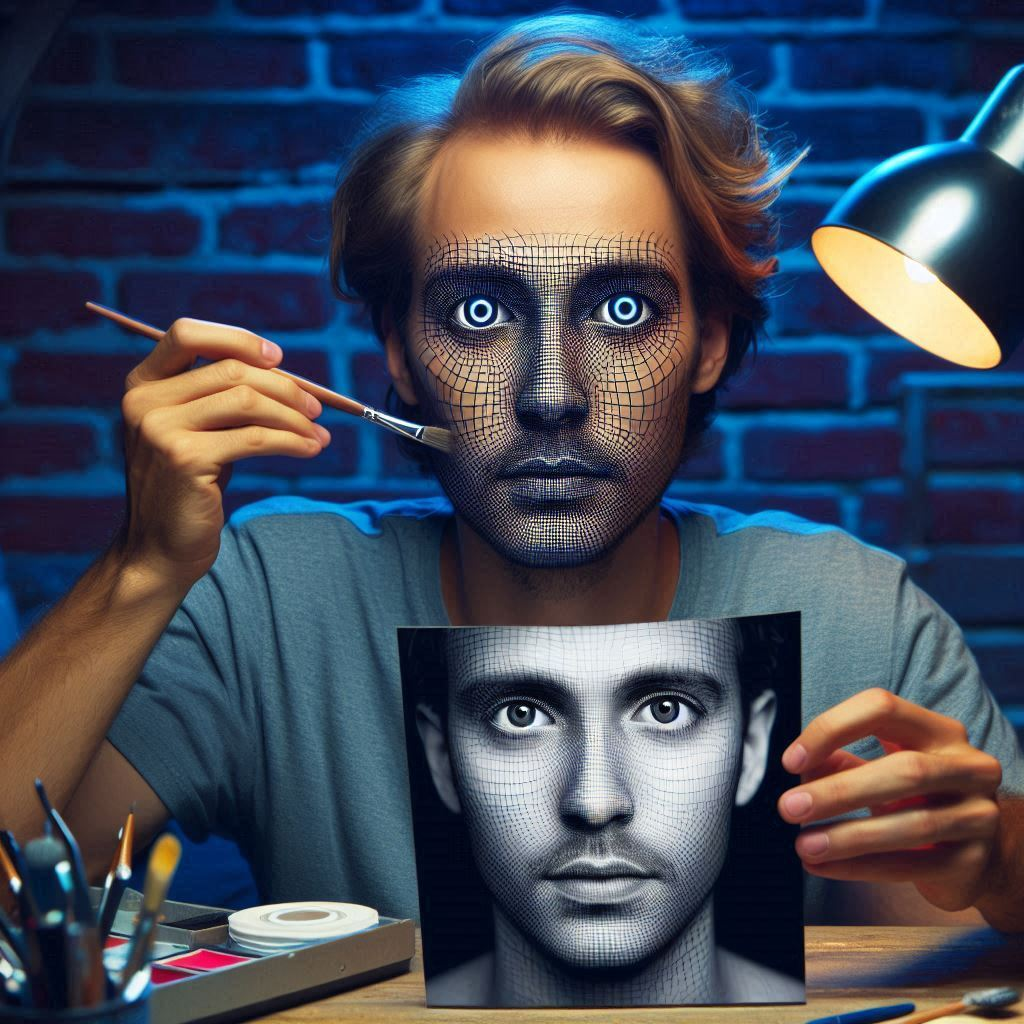

A produção de um deepfake começa com a coleta de dados, como imagens, vídeos e áudios de uma pessoa ou objeto. Utilizando algoritmos de deep learning, inspirados no funcionamento do cérebro humano, redes neurais artificiais são treinadas para reconhecer e mapear movimentos, expressões faciais e até o timbre de voz do indivíduo.

Após esse processo de aprendizado, as redes neurais conseguem sobrepor rostos em vídeos e imagens ou até gerar falas inéditas imitando a voz original a partir de um texto escrito.

Embora o resultado pareça autêntico, ele é inteiramente manipulado por inteligência artificial, criando uma versão falsificada da realidade.

Antigamente, a criação de deepfakes era um processo complexo e acessível apenas a especialistas. No entanto, com os avanços da inteligência artificial generativa e a popularização dessas tecnologias, qualquer pessoa pode produzir deepfakes com facilidade usando softwares e plataformas online, como DeepFaceLab e Faceswap.

Como os deepfakes replicam movimentos e expressões humanas de maneira realista?

Os deepfakes conseguem replicar de forma convincente movimentos e expressões humanas devido a treinamentos intensivos com grandes volumes de dados, técnicas de deep learning (aprendizado profundo) e o uso de redes neurais.

Durante o processo de aprendizado profundo, as redes neurais são alimentadas com vastas bases de dados, permitindo que reconheçam padrões de expressões faciais, gestos e até timbres de voz. Quanto mais dados sobre um indivíduo, mais precisa se torna a reprodução.

Além disso, o uso de Redes Neurais Generativas Adversárias (GANs) desempenha um papel crucial. Essas redes utilizam um sistema de geração e discriminação, no qual o gerador cria imagens e o discriminador avalia se são falsas ou reais. Esse ciclo de otimização constante garante que o resultado final seja tão realista que, muitas vezes, se torna impossível distinguir a falsificação da realidade.

Qual é a diferença entre deepfake e IA generativa?

O deepfake é uma técnica específica que utiliza inteligência artificial generativa para criar conteúdos falsos, manipulando fotos, vídeos e áudios existentes. Embora envolva redes neurais, o deepfake geralmente se baseia nas Redes Neurais Generativas Adversárias (GANs) para realizar as manipulações.

Por outro lado, a IA generativa é um conceito mais amplo, que abrange uma variedade de algoritmos de deep learning e redes neurais capazes de gerar novos conteúdos, como textos, áudios, vídeos, imagens, poemas e até códigos, a partir de dados de treinamento.

Em resumo, o deepfake é uma aplicação particular da IA generativa, mas não representa todo o seu potencial.

Quais são os principais exemplos de deepfake?

Os deepfakes podem ser aplicados tanto de maneira positiva quanto negativa em diversas áreas, como educação, política e entretenimento. Aqui estão alguns exemplos:

- Avatares e modelos virtuais: Deepfakes são usados para criar avatares em jogos ou modelos virtuais, como na simulação de roupas, para oferecer experiências mais imersivas.

- Memes e entretenimento: Deepfakes são frequentemente empregados em paródias de filmes e memes humorísticos, como na troca de rostos de celebridades ou na replicação das vozes de artistas para entretenimento.

- Fins educacionais: Redes neurais podem gerar personagens animados para ensinar ou esclarecer dúvidas em áreas educacionais, tornando a aprendizagem mais interativa e acessível.

- Fake news: No campo político, deepfakes são usados para criar vídeos falsos com rostos de políticos ou figuras históricas, com o objetivo de manipular a opinião pública ou beneficiar um candidato.

- Abuso sexual de imagem: Criminosos utilizam deepfakes para inserir rostos de celebridades em vídeos explícitos, criando situações comprometedoras e prejudiciais.

- Propagandas falsas: Deepfakes têm sido usados para criar anúncios falsos, inserindo rostos de pessoas famosas para enganar consumidores e promover produtos fraudulentos.

Como identificar um deepfake?

Embora os avanços nos algoritmos tornem os deepfakes cada vez mais realistas, existem alguns sinais que podem ajudar a identificar um conteúdo falsificado:

- Falas assíncronas: Um dos primeiros indicativos de um deepfake é a falta de sincronia entre a voz e o movimento dos lábios, onde o áudio não acompanha perfeitamente a expressão facial.

- Movimentos robóticos: Olhares inexpressivos, movimentos faciais bruscos ou repetidos, como piscadas de olhos, podem ser sinais de que um vídeo foi manipulado.

- Iluminação não linear: Se a iluminação no vídeo mudar abruptamente em diferentes quadros, afetando até o tom de pele da pessoa, isso pode indicar a presença de um deepfake.

- Deformações e alterações faciais: Em alguns casos, deepfakes podem apresentar deformações no rosto ou mudanças súbitas em características físicas, como um contorno facial distorcido.

- Marca d’água e rótulos em redes sociais: Alguns vídeos deepfake podem trazer marcas d’água do software utilizado para criá-los. Em redes sociais, é comum encontrar a indicação “Criado por IA” ou rótulos informando a origem da criação.

- Oscilações na voz: Se o tom de voz parecer inconsistente ou se houver mudanças abruptas no timbre, isso pode ser uma indicação de que o áudio foi manipulado.

- Ruídos no áudio: Áudios gerados por inteligência artificial frequentemente apresentam ruídos indesejados ou sons abafados, que não são típicos de gravações reais.

Quais são os riscos dos deepfakes?

O uso indevido de deepfakes pode resultar em várias consequências legais e prejudicar gravemente a imagem e a reputação das pessoas. Alguns dos principais riscos incluem:

- Desinformação e disseminação de fake news: Como os deepfakes distorcem a realidade, eles podem ser usados para espalhar informações falsas, manipulando a percepção pública.

- Crimes de difamação e calúnia: Além do constrangimento, deepfakes podem ser considerados crimes contra a reputação de alguém, dependendo do contexto e do uso.

- Violação de privacidade: Criar e distribuir deepfakes sem o consentimento de uma pessoa é uma violação clara da sua privacidade e de seus dados pessoais.

- Bullying e cyberbullying: Deepfakes prejudiciais à imagem de alguém podem ser usados em ataques de bullying online, levando a danos psicológicos e sociais severos para a vítima.

- Fraudes e golpes: A manipulação de imagens, vídeos e áudios por meio de deepfakes facilita a criação de golpes e anúncios fraudulentos, enganando consumidores e indivíduos vulneráveis.

- Falsificação de identidade: Quando os dados biométricos de uma pessoa são usados em deepfakes sem permissão, pode ocorrer falsificação de identidade, o que é uma violação grave da lei.

Existem formas de se prevenir contra deepfakes?

Sim, existem medidas que podem ajudar a reduzir o risco de ser vítima de deepfakes:

- Reforçar a proteção de dados pessoais: O primeiro passo é proteger suas informações pessoais, ajustando as configurações de privacidade nas redes sociais para limitar o acesso a fotos e vídeos de alta qualidade.

- Verificar fontes confiáveis: Ao consumir conteúdo, é essencial priorizar veículos de comunicação e canais oficiais de empresas e governos. Isso ajuda a confirmar a autenticidade de vídeos, áudios e fotos, e a reduzir a disseminação de fake news.

Essas ações ajudam a dificultar o uso indevido de suas imagens e informações, além de contribuir para uma internet mais segura e confiável.

Deepfake é crime no Brasil?

Atualmente, o uso de deepfakes não é tipificado como crime específico no Código Penal brasileiro. No entanto, sua aplicação ilegal pode violar diversas legislações, como a Lei Geral de Proteção de Dados Pessoais (LGPD), que protege a privacidade e os dados pessoais, podendo resultar em punições jurídicas.

O uso de deepfakes sem consentimento pode configurar violação de privacidade e de dados pessoais, conforme a LGPD. Além disso, dependendo do caso, deepfakes podem ser enquadrados em crimes contra a imagem, como difamação e calúnia, ou em fraudes de identidade.

Vale ressaltar que há Projetos de Lei em andamento no Brasil para regular o uso de deepfakes. O PL nº 1272/23 propõe criminalizar os deepfakes, enquanto o PL nº 5.695/23 busca incluir essa prática na Lei Maria da Penha. Outros projetos, como os PLs nº 145/24 e nº 146/24, visam regulamentar o uso de inteligência artificial em publicidade e aumentar as penalidades para crimes envolvendo deepfakes, como falsificação de identidade e crimes contra honra.

É permitido usar deepfake em propaganda eleitoral?

Não. Em fevereiro de 2024, o Tribunal Superior Eleitoral (TSE) proibiu o uso de deepfakes nas campanhas eleitorais ao atualizar a Resolução nº 23.610/2019. As novas regras também exigem a inclusão de avisos quando houver o uso de inteligência artificial nas propagandas eleitorais.

Candidatos(as) que utilizarem deepfakes poderão ter seus registros ou mandatos cassados. Além disso, pessoas que publicarem vídeos, fotos ou áudios manipulados por IA durante as campanhas políticas poderão ser multadas.

O que fazer se alguém criar um deepfake com sua imagem?

Se você descobrir que alguém criou um deepfake com sua imagem, é importante tomar as seguintes medidas:

- Salvar o deepfake e reunir informações: Guarde uma cópia do conteúdo manipulado e colete o máximo de dados possível, como o autor da postagem, data e horário, para usá-las como evidência.

- Reportar à rede social: Entre em contato com a plataforma onde o conteúdo foi publicado e solicite a remoção imediata do material, já que muitas redes sociais têm mecanismos para lidar com esse tipo de abuso.

- Procurar a delegacia especializada: Denuncie o caso em uma delegacia de crimes cibernéticos no seu estado, onde as autoridades poderão investigar o incidente.

- Buscar apoio jurídico: Consulte um advogado especializado para avaliar a possibilidade de mover uma ação judicial com base em infrações previstas na legislação brasileira, como violação de imagem e privacidade.

Essas ações podem ajudar a proteger seus direitos e a combater o uso indevido de sua imagem.

Luiza Fontes é apaixonada pelas tecnologias cotidianas e pelo impacto delas no nosso dia a dia. Com um olhar curioso, ela descomplica inovações e gadgets, trazendo informações acessíveis para quem deseja entender melhor o mundo digital.